연구자 수 부족…전 세계 100~200명 불과

“연구 자금 늘리고 신규 연구자 유입 촉진해야”

영국의 통계학자이자 공상 과학 소설가인 어빙 존 굿은 60여 년 전 이런 말을 남겼다. 그리고 챗GPT의 등장을 계기로 인공지능(AI)이 놀라운 속도로 발전해나가면서, 그가 남긴 이 말이 재조명되고 있다.

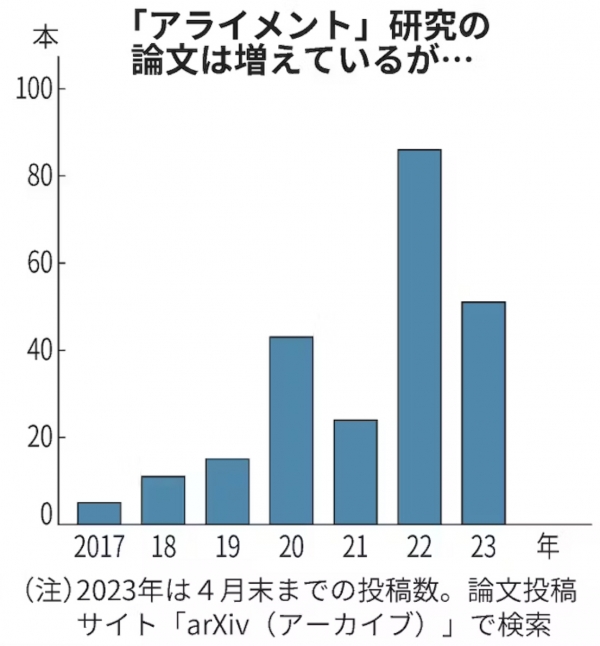

일본 니혼게이자이신문(닛케이)은 최근 “AI의 급격한 발전에 따라 ‘얼라인먼트’라 부르는 기술이 주목을 받고 있다”고 보도했다. 얼라인먼트는 AI 시스템이 인간의 의도된 목표나 윤리적 원칙에 따라 움직이도록 조종하고 제어하는 기술이다. 날뛰는 경주마를 고삐를 쥐고 훈련하는 기수처럼 AI의 위험성을 통제하는 것이다. 어빙 존 굿이 말한 ‘초지능 기계 자신을 통제하는 방법’이 바로 이 기술인 셈이다.

AI는 대량의 데이터에 파묻힌 법칙성을 찾아내는 데 능숙하다. 다만 도출한 최적의 답변이 이용자의 의도와 동떨어지면서 되레 해를 끼칠 위험이 있다. 일례로 자동차 운전자에게는 ‘제한 속도를 지킨다’나 ‘안전하게 운전한다’는 준수 의식이 있지만, AI는 그렇지 않다. 자율주행차에 “비행기 시간을 놓치지 않게 서둘러라”라고 지시하면, 차량은 초스피드로 추월하며 공항으로 향할지도 모른다. 이렇게 되면 탑승자는 위험에 노출될 수 있으며, 안전하게 도착하더라도 두려움을 느끼게 된다. 얼라인먼트는 이런 문제를 일으키지 않도록 AI를 길들인다.

얼라인먼트는 안전성 향상과 미래의 위험을 줄이기 위해 빼놓을 수 없는 기술이다. 향후 AI가 인간을 공격하는 위험한 존재가 됐을 때도 대항 수단이 될 것이라고 닛케이는 전망했다.

하지만 얼라인먼트의 실현은 절대 쉽지 않다. 인간의 가치관도 개인마다 차이가 크기 때문이다. 특히 AI는 기술이 고도화 될수록 규모가 커지고 내부 구조도 복잡해진다. 그만큼 요구되는 얼라인먼트의 수준도 올라간다. 다카하시 코이치 게이오기주쿠대학 교수는 “고도의 AI가 이용자의 의도대로 움직이도록 보증하는 것은 상당히 어렵다”고 지적했다.

미국과 영국 정부는 지원에 나섰다. 양국 정부는 안전한 AI 실현을 위해 각각 1억4000만 달러(약 1849억 원), 1억 파운드(약 1634억 원) 를 투입하기로 했다. 자금이 전부 얼라인먼트 연구에 쓰이는 것은 아니지만, 관련 연구 프로젝트 제안도 받을 것으로 알려졌다.

최근 AI 발전을 둘러싸고는 윤리, 법률, 안전보장 등 다양한 측면에서 우려의 목소리가 제기되고 있다. 닛케이는 “AI 사용과 관련한 규제 도입도 중요하지만, AI를 안전하게 사용하기 위한 기술 개발도 마찬가지로 중요하다”고 강조했다.

![먹을 사람 없고 귀찮아서…"김장, 안 하고 사 먹어요" [데이터클립]](https://img.etoday.co.kr/crop/320/200/2098061.jpg)